A dimensão da interferência de robôs em debates públicos, principalmente em períodos eleitorais, representa um desafio para centros de pesquisa e para o Twitter.

O microblog é, entre as redes usadas para a troca de informações no Brasil, a que abre mais dados à pesquisa.

Mesmo assim, especialistas apontam a perseguição por contas automatizadas na plataforma como um “jogo de gato e rato”.

Coordenador do Laboratório de Estudos sobre Imagem e Cibercultura da Universidade Federal do Espírito Santo, Fábio Malini diz que a computação trabalha com dados muito objetivos e que, quando se adiciona o fator político, o Twitter “entra em curto-circuito”.

“As hashtags não são infladas apenas por robôs simples, mas por contas semiautomatizadas que replicam por plataformas como TweetDeck [site que permite o gerenciamento de diferentes contas]”, diz.

“Há uma dificuldade muito grande de o Twitter e os pesquisadores cravarem o quantitativo”, afirma.

Segundo ele, o desafio para as duas partes está em englobar em um só cálculo os bots (perfis automatizados), os trolls (usuários que não precisam ser robôs e que usam a rede para disseminar ódio ou difamação), os botspammers (robôs que enviam mensagens não autorizadas) e os ciborgues (perfis operados por humanos e computadores).

Pesquisadores fazem suas análises com base em dados coletados via API (interface que permite que desenvolvedores integrem programas à plataforma). Eles dispõem de quase 50 tipos de dados sobre as contas pessoais.

Só o Twitter tem acesso a dados sensíveis como o IP (endereço eletrônico) veiculado às contas –sinal importante para a assertividade na identificação de agentes maliciosos.

Enquanto analisa se excluirá uma conta ou não, o Twitter diz que inibe a visibilidade desse perfil ao público, mas que ele permanece ativo aos pesquisadores na API. “[Isso] não é refletido nas informações que os pesquisadores levam em conta para fazer levantamentos”, diz a empresa.

Dessa forma, não é possível saber nem pelo Twitter nem pelas pesquisas o tamanho do problema de automação.

Além da metodologia sigilosa da empresa, não há um padrão internacional que certifique o que é robô malicioso.

Centros de pesquisa e empresas, com levantamentos metodológicos próprios, ensaiam maneiras de identificar um número de automatização a partir dos dados externos.

O cenário muda de acordo com a instituição.

No Brasil, a FGV-DAAP (Diretoria de Análise de Políticas Públicas da Fundação Getulio Vargas) faz esse tipo de análise desde 2014.

O pesquisador Danilo Carvalho diz que a metodologia é conservadora, pois considera só dois critérios.

A FGV entende como robôs as publicações consecutivas com intervalo inferior a um segundo, feitas repetidamente, e contas que usam plataformas de automação.

Já a AP Exata faz levantamentos mercadológicos para clientes. Detectou, por exemplo, que a palavra “venezuelanos”, durante a crise de imigração em Roraima, gerou 21.684 tuítes em 20 dias. Desses, 17,6% eram de “interferência”.

A empresa usa essa nomenclatura porque, se tentar detectar apenas robôs, sua margem de erro aumenta.

Ela inclui na categoria perfis militantes aqueles que são usados quase exclusivamente para falar sobre um único tema. Podem não ser robôs, trolls ou contas semiautomatizadas.

“Colocamos todo o mundo dentro do mesmo saco porque não temos como provar, de acordo com os dados que o Twitter disponibiliza, o que é robô ou não”, diz Ricardo Martins, analista de sistemas.

Especialistas veem o Brasil atrasado na ciência de detectar esses agentes por não ter processos de verificação testados por pares científicos.

Os esforços do Twitter são reconhecidos pelos acadêmicos, embora a evolução computacional exija urgência.

“Eles implementaram mudanças, fizeram uma limpeza. O problema é que esse tipo de robô que excluíram é o ladrão de galinha. Os bots que imitam o comportamento humano serão outro tipo de desafio”, diz

Fabrício Benevenuto, professor da Universidade Federal de Minas Gerais.

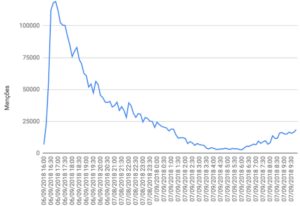

Em nota, o Twitter diz que “trabalha globalmente e em escala para detectar e combater proativamente spam e contas automatizadas mal-intencionadas” e que excluiu 214% mais contas em um ano.

Glossário

Bots: perfis automatizados

Trolls: Usuários que não necessariamente são robôs e que usam a rede para disseminar ódio ou difamação

Botspammers: Robôs que enviam mensagens não autorizadas

Ciborgues: perfis operados por humanos e computadores